IT 일반

네이버 파파고, 이미지 자동으로 읽고 바꾸고 덮어쓴다 [가봤어요]

- ‘더 똑똑해진’ 파파고, ‘AR 번역’ 기술·노하우 공개

‘텍스트 렌더링’ 기술…원문 이미지·색·구조 그대로

[이코노미스트 송재민 기자] 번역기는 지금까지 인간의 언어를 모방하는 ‘어설픈 흉내’처럼 여겨졌다. 어색한 말투를 구사하는 사람에게 “번역기 같다”는 수식어를 붙이기도 했다. 그러나 기술이 고도화되면서 자연스러운 번역은 물론 이미지를 읽어 번역하는 ‘증강현실(AR) 번역’의 시대가 도래했다. 더 빠르게, 더 자연스럽게, 더 읽기 쉽게 네이버 파파고는 기술의 혁신을 거듭하고 있다.

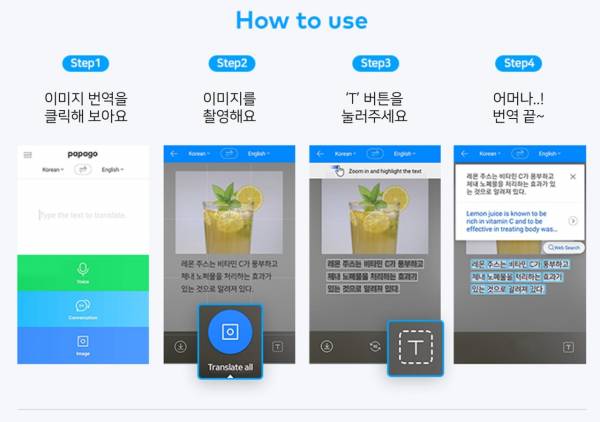

네이버 파파고가 지난 8월 출시한 AR 번역은 기존에 제공하고 있던 ‘이미지 바로 번역’ 서비스를 업그레이드했다. 카메라에 비치는 화면을 따로 촬영하지 않아도 실시간으로 번역해주는 서비스다. 해당 기능이 구현되기까지 과정을 설명하는 자리가 27일 서울 강남구 삼성동 코엑스에서 열린 네이버의 개발자 콘퍼런스 ‘데뷰(DEVIEW) 2023’ 중 마련됐다.

이현수 파파고 엔지니어는 ‘더 잘 읽히고 자연스러운 이미지 번역을 위해’란 세션 발표에서 파파고에서 고도화해온 텍스트 렌더링 기술과 노하우를 공유했다. 이 엔지니어는 “이미지에 글자를 쓰려면 도화지 같은 배경 이미지가 필요하다”며 “번역 결과를 자연스럽게 합성하기 위해 원본 텍스트가 제거된 배경 이미지를 만드는 기술”이라고 인페인팅을 소개했다.

이미지를 자동으로 읽고, 번역한 뒤 사용자에게 이미지 그대로 보여주는 기술은 단순하지 않다. 촬영할 때 손의 떨림으로 사진이 흔들리거나 그림자가 져 어둡게 나오거나 텍스트 외부의 구획이나 배경 등으로 잘 보이지 않는 경우 등 다양한 변수가 발생한다. 이러한 상황들을 예상하고 보다 정확하고 보기 쉽게, 원문과 비슷하게 구현해내는 기술이 딥러닝 학습 모델을 기반으로 한 ‘인페인팅’(Inpainting) 기술이다.

해당 기술을 접목하면 스마트폰을 통해 마치 눈으로 보는 것처럼 번역이 가능하다. 편의성과 만족도를 높인 이미지 바로 번역 서비스는 출시 대비 사용자가 3배 가까이 증가했다.

‘부자연스러움’ 해결 위한 네이버 파파고의 접근법

기존 파파고에서 사용하던 기술은 수정테이프로 원본 이미지 속 텍스트를 덮고 그 위에 번역한 텍스트를 덮어쓰는 식이다. 배경색을 글자 색과 대비되는 단색으로 처리하고 사각형 패치로 만든 후 원본 이미지에 붙여 넣는다. 이렇게 해도 글자를 읽는 데는 큰 문제는 없다. 그러나 문제는 ‘부자연스럽다’는 점이다. 이 엔지니어는 “이렇게 하면 이미지 내에 그림자의 변화나 명도 변화가 너무 심하게 일어나 마치 색종이를 붙인 것 같은 이질감이 발생할 수 있다”며 “사용자가 만족할 만한 자연스러운 배경 이미지를 만들어내고자 자체적으로 모델을 개발해 개선했다”고 말했다.

학습된 딥러닝 모델이 글자가 포함된 이미지를 입력받으면 바로 원본 이미지와 유사하지만, 글자만 없는 배경 이미지를 생성해준다는 설명이다. 파파고의 독보적인 인페인팅 기술은 글로벌 학회인 ‘유럽컴퓨터비전학회(ECCV) 2022’에서 논문으로 발표되며 그 발전 성과를 인정받은 바 있다.

배경 이미지가 만들어지고 나면 그 위에 텍스트를 합성해야 한다. 준비된 배경 이미지에 번역한 텍스트를 입히기만 하면 될 것 같지만 관건은 역시나 ‘자연스러움’이다. 이 엔지니어는 “번역 결과를 어떻게 제공해야 가독성이 좋을지 고민한 결과, 원본 텍스트의 색상을 유지하는 것이 가장 자연스러울 것이라고 판단했다”며 “인페인팅 기술을 응용해 배경과 텍스트를 각각 분리할 수 있어, 텍스트의 원본 색상이 보다 정확하게 추출된다”고 설명했다.

그러나 흔들린 이미지의 경우 추출된 색상을 그대로 렌더링에 활용하게 되면 흐릿한 색상으로 사용자에게 제공되는 문제가 생긴다. 이미지 내 그림자 변화가 극심한 경우도 마찬가지다. 한 쪽 부분의 색상으로만 추출해 제공하면 다른 부분의 글자를 식별하기 어려워진다. 파파고는 추가 고도화 작업을 통해 가장 읽기 편안한 글자 색과 배경색의 대비 기준에 부합하도록 조정한다. 글자 색이 배경색보다 밝다면 더 밝게, 글자 색이 배경색보다 어둡다면 더 어둡게 만드는 식으로 색을 조절해 가독성을 높이는 식이다.

가독성을 높이는 또 다른 기술은 ‘글자 정렬 추출’이다. 글자를 ‘어디를 기준으로’ 다시 써줘야 자연스러울지를 고민한 결과물이다. 대부분의 이미지 번역 서비스는 왼쪽 정렬을 기본으로 한다. 원본의 텍스트 정렬 방식을 고려하지 않기 때문에 글자 배열이 불규칙하게 흐트러지거나 원본이 전달하고자 하는 바를 이해할 수 없는 경우가 많다. 파파고는 이용자들이 번역 결과를 편하게 읽을 수 있도록 정렬 방식을 추출하는 딥러닝 모델을 개발해 적용했다.

이 엔지니어는 “정렬 추출을 좀 더 정확하게 하기 위해서는 글자 간의 포지션 관계뿐만 아니라 이미지 전체적인 비주얼 퓨처를 고려해야 한다고 결론지었다”며 “(딥 러닝 모델로) 문단 구조뿐만 아니라 텍스트 이외의 외적인 요소도 복합적으로 고려해 정렬을 파악할 수 있다”고 강조했다.

렌더링의 마지막 단계로 번역한 결과를 작성할 수 있는 렌더러블 영역을 확보해야 한다. 번역을 하게 되면 원어의 글자 수와 번역된 글자 수가 크게 달라지는 경우가 존재한다. 기존처럼 텍스트가 원래 존재했던 영역에 번역 결과를 그대로 합성하면 글자 크기가 지나치게 작아져 가독성을 해치게 된다. ‘경계선 검출’(Edge Detection)은 번역 텍스트가 어떤 영역을 넘어서면 안 되는지를 추론해 각 영역이 충돌하지 않는 선에서 최적의 영역을 확보해 가독성을 높이기 위해 개발된 기술이다.

이 엔지니어는 “파파고 이미지 번역은 HTS(Hierarchical Text Structuring)·인페인팅 등 원천기술을 구현해 이용자들에게 만족도 높은 번역 결과를 제공한다는 점이 특징”이라며 “최고의 번역 품질을 위해서는 번역 결과뿐만 아니라 렌더링을 통한 사용자 경험(UX) 개선도 중요하다. 이용자들에게 더욱 자연스럽고 가독성 좋은 번역 결과를 제공할 수 있도록 렌더링 기술력을 꾸준히 고도화해 나갈 것”이라고 말했다.

ⓒ이코노미스트(https://economist.co.kr) '내일을 위한 경제뉴스 이코노미스트' 무단 전재 및 재배포 금지

![[단독] ‘제2의 곽튜브’ 꿈꾸는 이자반 “전 여자친구와 이별로 유튜브 시작… 반지하서 성공 일기 쓸 것” [IS인터뷰]](https://img.edailystarin.co.kr/data/isp/image/2026/05/11/isp20260511000046.400.0.jpg)

![혹시 밥 친구가 필요하세요?... 그렇다면 오늘은 ‘이자반’ [김지혜의 ★튜브]](https://img.edailystarin.co.kr/data/isp/image/2026/04/19/isp20260419000032.400.0.png)

당신이 좋아할 만한 기사

브랜드 미디어

브랜드 미디어

이란 외무 "미국 신뢰 안해…전쟁·외교 모두 준비"

세상을 올바르게,세상을 따뜻하게이데일리

이데일리

이데일리

‘1인 기획사 미등록 운영’ 성시경 소속사 기소유예

대한민국 스포츠·연예의 살아있는 역사 일간스포츠일간스포츠

일간스포츠

일간스포츠

트럼프 "시진핑과 북한 문제 논의…대만 관련 약속 안해"

세상을 올바르게,세상을 따뜻하게이데일리

이데일리

이데일리

[마켓인]‘A-’ 안 주면 끊는다…제2 제이알사태 막을 규제 시급

성공 투자의 동반자마켓인

마켓인

마켓인

중동발 씽크 첫 계약도 연내 터진다...씨어스, 글로벌 확장 가속화

바이오 성공 투자, 1%를 위한 길라잡이팜이데일리

팜이데일리

팜이데일리